Pensez à vous abonner sur notre librairie en ligne, c’est grâce à cela que nous tenons bon !

L’intelligence des élèves, sa mesure et l’hétérogénéité des classes

Dès l’origine, le débat a opposé les tenants d’une intelligence unidimensionnelle aux tenants d’une intelligence multifactorielle. La première correspond à une capacité générale, s’exprimant dans différents domaines tels que la mémoire, le langage ou le raisonnement, et renvoie au facteur général de l’intelligence, le facteur « g », découvert par Spearman (1863-1945) ou à ce que mesure le QI. C’est la position de Binet (1911) qui considère que « l’esprit est un, malgré la multiplicité de ses facultés » (p. 86) et de Weschler (1944) qui assimile l’intelligence à « quelque chose qu’on espère voir émerger de la somme totale des résultats obtenus par le sujet » (p. 7). Sur cette dimension unique les individus se classent du plus intelligent au moins intelligent. En revanche, une intelligence multifactorielle telle que la concevait Thurstone (1887-1955) repose sur une multitude d’aptitudes indépendantes dont la mesure exige une batterie de tests. Une conception hiérarchique de l’intelligence, dans laquelle des aptitudes spécifiques à différents domaines forment la base de la pyramide et le facteur g le sommet, est aujourd’hui acceptée. Les protagonistes de ce débat considéraient que l’intelligence reposait exclusivement sur des processus cognitifs et n’englobait pas nécessairement d’autres dimensions de la personnalité. Gardner (1977) a proposé un modèle d’intelligences multiples indépendantes entre elles : kinesthésique (capacité à gérer son corps), intra personnelle (capacité à se comprendre soi-même), interpersonnelle (capacité à comprendre les autres), musicale, etc. Ces différentes intelligences sont inaccessibles aux tests psychométriques classiques qui ne mesurent que la forme logico-mathématique, verbale ou académique de l’intelligence valorisée par le système scolaire. A l’appui de cette thèse on peut citer Goleman (1997) ou Damasio (1995) qui montrent, chacun à leur manière, l’imbrication du raisonnement (la cognition froide) et des émotions (la cognition chaude) dans toutes les activités humaines.

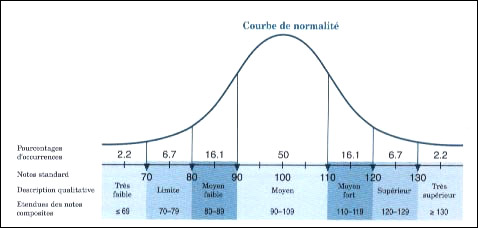

On n’a pas attendu de savoir définir l’intelligence pour tenter de la mesurer. Au début du 20° siècle, avec l’entrée en vigueur des lois de Jules Ferry, la scolarité se généralise et on observe vite que certains enfants sont incapables de suivre l’enseignement dans la classe ordinaire. En 1904 une commission interministérielle demande à Binet de mettre au point un instrument permettant d’identifier ces enfants pour les orienter vers un enseignement spécial. A l’origine, la question est donc moins de mesurer l’intelligence que de dépister ses déficiences. En 1905, Binet et son collaborateur le docteur Simon, proposent une première version de leur Echelle Métrique de l’Intelligence pour évaluer le niveau mental des écoliers. Cette évaluation est fondée sur les processus mentaux supérieurs tels que la mémoire, les images mentales, l’imagination, l’attention, la compréhension, etc. Suite à un énorme travail empirique et à une série de tâtonnements, Binet et Simon choisissent et hiérarchisent une série de questions et d’exercices, sensés faire appel à ces processus : donner son nom de famille (3 ans), répéter 3 chiffres (4 ans)… compter à rebours de 20 à 0 (8 ans), etc. On parlera bientôt d’âge mental (AM) pour caractériser la performance d’un enfant en référence à la performance moyenne des enfants des différents groupes d’âge. Par exemple, un enfant de 5 ans a un âge mental de 6 ans si sa performance est équivalente à celle de l’enfant moyen de 6 ans. Mais il est clair qu’un âge mental de 6 ans n’a pas la même signification si l’enfant a un âge réel de 5 ans ou de 7 ans. L’un est en avance alors que l’autre est en retard d’un an sur la trajectoire de développement. Pour rendre l’évaluation moins dépendante de l’âge, Stern en 1912 effectuera le rapport entre l’âge mental et l’âge réel et parlera de quotient intellectuel : QI = (AM/AR) x 100. L’enfant précédent a un QI de (6/5) x 100 soit 120. Notons cependant que le même QI de 120, par exemple, correspond à un an d’avance à 5 ans (AM = 6 ans) et à deux ans d’avance à 10 ans (AM = 12 ans). L’échelle de Binet et Simon, associée au QI de Stern, connaît un succès foudroyant qui dépasse largement l’objectif initial et qui lance le courant de recherche sur la mise au point de tests d’intelligence. Elle est adaptée aux Etats-Unis par Terman et reétalonnée en France sous l’appellation de Nouvelle Echelle Métrique de l’Intelligence par Zazzo, Gilly et Verba-Rad en 1966. Cependant, le concept d’âge mental, qui n’a de sens que pendant la période de développement cognitif, se heurte à une limite naturelle d’application quand les notes moyennes n’augmentent plus avec l’âge ce qui est le cas vers 15 ans et chez l’adulte. C’est pour cette raison que Weschler mit au point un test pour adulte (Weschler Adult Intelligence Scale) en abandonnant les notions d’âge mental et de quotient AM/AR. Ce test connut à son tour un grand succès qui encouragea l’auteur à mettre au point, selon les mêmes principes, une échelle pour enfants (Weschler Intelligence Scale Children). Ces tests ont été traduits en français et plusieurs fois rénovés. Weschler caractérise la performance de chaque individu par le rang qu’elle occupe dans la distribution des performances du groupe de référence. Comme on le voit sur la figure (insérer ici la courbe normale), par construction cette distribution est normalisée avec une moyenne ou une médiane de 100 (le sujet qui obtient une note standard de 100 obtient la note moyenne de son groupe de référence et a 50% des sujets de son groupe qui ont fait mieux que lui et 50% qui ont fait moins bien) et une variance telle que 50% des sujets ont un QI compris entre 90 et 109. Ainsi, même si l’on a continué à parler de QI, le score obtenu avec la WISC n’est pas un quotient mais un rang dans un groupe de référence. C’est un indice de l’intelligence d’un sujet par rapport à l’intelligence moyenne, fixée à 100, des sujets du groupe de référence défini dans le temps et dans l’espace. Par exemple on voit sur la courbe que notre enfant de 5 ans aura un QI de 120 si sa performance appartient aux 8,9% meilleures performances obtenues par le groupe des enfants de 5 ans. La WISC-IV actuelle (Grégoire, 2006) tient compte des avancées de la psychologie cognitive, de la neuropsychologie et des formalisations de l’approche factorielle. La distinction classique entre un QI verbal et un QI performance est abandonnée au profit de quatre indices : Compréhension Verbale, Raisonnement Perceptif, Mémoire de Travail, Vitesse de Traitement.

Les tests ont leurs défenseurs et leurs détracteurs. Ils rendent des services pratiques en permettant un dépistage satisfaisant de la déficience mentale ou du haut potentiel intellectuel et une formulation de pronostics fiables de la réussite scolaire. On considère donc qu’ils sont valides non pas parce qu’ils mesurent bien l’intelligence mais parce qu’ils confortent des jugements portés de l’extérieur sur les individus. Ils ne sont pas exempts de critiques. Celles-ci ont germé dans les années 60 et se sont accentuées avec les remises en cause de mai 68. A la suite des publications de Bourdieu et Passeron et de Baudelot et Establet une partie de la communauté scientifique et plus largement une partie de la société a pris conscience que les tests n’avaient pas de fondement scientifique, renvoyaient avec le courbe de Gauss, à une conception fixiste et innéiste de l’intelligence, étaient socialement biaisés, entraînaient donc des observations pseudo-scientifiques susceptibles d’être exploitées pour défendre des positions idéologiques et finalement participaient, comme l’école, à la reproduction de la stratification sociale. Le livre polémique de Tort (1974) publié dans ce contexte présente des arguments qui montrent que le test n’est pas un instrument neutre d’une psychologie neutre mais qu’il mesure l’appartenance sociale et les rapports à la scolarité des enfants.

Même si le QI est un nombre qui a pour lui tout le poids de la science, il est exact que faute de fondement scientifique solide les tests d’intelligence reposent essentiellement sur des bases statistiques. Des épreuves inspirées de la théorie piagétienne du développement de l’intelligence auraient pu constituer une alternative intéressante. Cette théorie qui faisait alors l’unanimité définit en terme de stade les niveaux successifs du développement de l’intelligence. Elle décrit de façon très précise les tâches utilisées et les performances produites par des enfants d’âges différents. L’idée de base a donc consisté à standardiser les tâches utilisées par Piaget et ses collaborateurs dans leur recherche pour obtenir les exercices d’une échelle de niveau. On peut citer l’Echelle de la Pensée Logique et les Tests d’Opérations Formelles de Longeot qui visent à évaluer le stade de développement opératoire atteint par le sujet. Contrairement au QI qui fixe abusivement l’efficience intellectuelle d’un enfant, les tests piagétiens voulaient l’inscrire dans une dynamique développementale théoriquement formalisée. Cette tentative s’est avérée décevante. D’un point de vue méthodologique elle a montré que l’on ne pouvait pas séparer les tâches de l’examen clinico-expérimental dans lequel elles s’inséraient et d’un point de vue théorique elle a mis en évidence une grande variabilité intra individuelle des performances. Bref ! les psychologues ont compris que l’on ne pouvait pas passer mécaniquement d’une théorie visant à établir les lois du développement de la connaissance chez un sujet épistémique à une pratique psychologique visant à comprendre le fonctionnement psychologique d’enfants réels.

Le QI est considéré comme caractérisant l’individu de façon intemporelle. L’enfant qui passe le test à 8 ans peut donc être étiqueté pour toute sa vie. Pour que le QI d’un individu reste stable il faut que sa position dans son groupe de référence ne change pas, comme si le développement consistait en une simple translation du groupe d’un niveau d’âge à un autre. Cette stabilité est vraie en moyenne mais sur le plan individuel tout changement d’environnement éducatif (immigration, modification de l’environnement familial, etc.) peut avoir des effets positifs ou négatifs sur le développement intellectuel et donc est susceptible de faire varier le QI. Des études de l’INED mettent en évidence que le QI des enfants immigrés peut augmenter de 10 points en quelques années. Il faut aussi évoquer l’effet « Flynn » du nom du chercheur qui a mis en évidence l’augmentation régulière du QI de 0,25 point en moyenne par an. Cette augmentation, dont les causes sont multiples (scolarité, pratiques éducatives familiales, améliorations des conditions de vie, évolution technologique de la société, etc.), entraîne un vieillissement de la norme qui peut fausser l’évaluation de plusieurs points si le psychologue ne renouvelle pas régulièrement son matériel.

A la suite des travaux pionniers de Galton sur l’usage des statistiques en psychologie, les chercheurs intéressés par la mesure de l’intelligence ont utilisé la courbe de Gauss pour étalonner les notes brutes obtenues aux tests. Cette technique repose incontestablement sur une hypothèse naturaliste de l’intelligence qui ne faisait guère de doute à cette époque. Si l’intelligence est un don de la nature elle doit effectivement se distribuer normalement dans une population. Seules les variables déterminées par les lois du hasard ou dépendant d’une infinité de petites causes indépendantes dont les effets se neutralisent se distribuent normalement. Le dogme gaussien est compatible avec l’idéologie des dons répartis au hasard dans la société mais pas avec une intelligence influencée par l’origine sociale.

Ce biais social devenait justement de plus en plus insupportable dans l’ambiance contestataire de la fin des années 60. La mesure de l’intelligence ne serait-elle que la mesure de l’inégalité des hommes ? On trouve en effet des écarts d’une quinzaine de points entre le QI moyen des enfants de manœuvres ou d’ouvriers agricoles et celui des enfants de cadres supérieurs. Si les enfants de cadres supérieurs sont plus performants que les autres sur tous les indices, les différences les plus fortes et qui s’accentuent avec l’âge sont observées sur les épreuves verbales et les plus faibles sur les épreuves non verbales. Ce profil suggère que les tests avantagent les enfants des classes aisés car leur contenu est plus proche de leur culture : les questions posées réfèrent à des situations, des automatismes et font appel à des savoirs qui leur sont plus familiers, la situation d’examen elle-même est vécue comme moins menaçante. Bref ! Les tests n’évaluent pas l’intelligence mais des conduites qui témoignent de l’appartenance à la classe sociale dominante. Comme l’enseignement avantage lui aussi les enfants favorisés culturellement, il n’est pas étonnant que les tests possèdent une valeur prédictive certaine.

Pour ces différentes raisons, à partir des années 70 les tests sont de moins en moins enseignés à l’Université et de moins en moins utilisés par les praticiens. Plus récemment, la question des enfants considérés comme « surdoués », « à haut potentiel », « intellectuellement précoces » a relancé le débat sur la définition de l’intelligence, l’utilisation des tests pour la mesurer, l’inné et l’acquis, l’égalité des chances à l’école, etc.

Les corrélations entre niveau d’intelligence mesurée par les tests et appartenances sociales ont alimenté le débat sur l’origine des différences interindividuelles. Les enfants de cadres réussissent mieux les tests que les enfants d’ouvriers. C’est un fait. Sont-ils plus intelligents pour cela ? Si cette supériorité est supposée réelle, est-elle héréditaire ou déterminée par l’environnement familial ? Pour répondre à ces questions les chercheurs se sont demandés par exemple si des jumeaux homozygotes adoptés dans les premiers jours de la vie par des familles différentes appartenant à des milieux culturels contrastés avaient des QI différents ou si un enfant dont les parents biologiques ont un QI faible devenait plus intelligent quand il était éduqué par des parents adoptifs ayant un QI élevé (cf. Duyme dans ce numéro). Ces études dont les conclusions en termes de pourcentages d’influence de l’innée et de l’acquis sont souvent contradictoire peuvent être critiquées : il s’agit de travaux empiriques basés sur des comparaisons statistiques (on ne connaît pas les « gènes de l’intelligence » et aucun gène spécifiquement associé au QI n’a était trouvé), les deux facteurs gènes et culture sont dissociés comme s’ils étaient indépendants et que leur effet s’ajoutaient (or, les interactions sont complexes), elles ne distinguent pas les facteurs génétiques des facteurs prénataux (deux jumeaux monozygotes ne naissent pas identiques, les conditions de vie pendant la grossesse peuvent avoir des conséquences sur le fœtus, etc.), elles peuvent être faussées par les préjugés des chercheurs (Burt a inventé des résultats pour soutenir la thèse de l’hérédité biologique), elles entraînent des débats idéologiques aussi vains que celui sur le sexe des anges.

Sur le plan idéologique on trouve deux positions contrastées. Si les capacités de l’individu sont déterminées par les gènes qu’il a hérités de ses parents alors tout est pour le mieux dans le meilleur des mondes. On naît intelligent ou imbécile comme on naît blanc ou noir. Certains ont la chance de naître intelligents d’autres pas. Il est dès lors inutile de lutter contre ces inégalités sociales puisqu’elles sont la conséquence d’inégalités génétiques naturelles contre lesquelles personne ne peut rien. L’ouvrier est ouvrier, comme son père, parce que ce statut correspond à son niveau intellectuel. Aux USA les noirs sont pauvres et occupent les emplois les moins qualifiés parce qu’ils sont moins intelligents que les blancs. On doit se contenter d’organiser la société en conséquence. Les enfants d’ouvriers échouent à l’école parce que leur niveau intellectuel est insuffisant : c’est inscrit dans leurs gènes. On doit encore se contenter d’enregistrer ce fait et d’organiser le système scolaire en conséquence. On le voit, exploités idéologiquement, certains de ces travaux peuvent répandre l’idée selon laquelle les hiérarchies professionnelle et sociale épousent la hiérarchie des intelligences. La mesure de l’intelligence légitime « scientifiquement » la discrimination sociale et l’organisation en classes sociales de la société. En revanche, si les capacités de l’individu sont influencées par son environnement (famille, éducation, stimulation intellectuelle, soutien scolaire, encouragements, attentes, etc.) alors le progrès social est susceptible de diminuer les inégalités. Simone de Beauvoir en affirmant « On ne naît pas femme on le devient » soulignait que l’éducation est déterminante dans la fabrication du sexe psychologique : les petites filles jouent à la poupée et les garçons à la guerre. On peut dire de la même manière qu’on ne naît pas intelligent ou imbécile mais qu’on le devient et souligner ainsi que l’éducation est déterminante dans la construction de l’intelligence. Généralement, les tenants de la position « innéiste » sont de droite et les tenants de la position « environnementaliste » sont de gauche. Je ne sais pas si les tenants du 50/50 sont centristes.

Le débat est aujourd’hui moins passionné (quoi que ?). On ne peut pas concevoir une réglette avec un seul bout, une pièce de monnaie avec une seule face. De la même façon il est admis que l’on ne peut pas concevoir l’être humain en séparant les gènes et l’environnement. Le développement de tout individu est 100% génétique et 100% environnemental. D’un côté on peut dire que l’environnement n’aura pas les mêmes effets selon les gènes et de l’autre on peut dire que les gènes n’auront pas la même expression selon l’environnement. Autrement dit, les gènes déterminent les effets de l’environnement et l’environnement détermine l’expression des gènes. On utilise parfois une métaphore musicale pour illustrer cette interaction : La partition (les gènes) est proposée au pianiste (l’environnement) et on écoute la mélodie (la réalité phénotypique). Si la partition est mal écrite (génétique) ou si le pianiste est défaillant (environnement) la mélodie sera déficiente. Un environnement défavorable (un mauvais pianiste) peut avoir un effet désastreux sur la mélodie (le développement intellectuel de l’enfant) même si la partition est excellente (patrimoine génétique) alors qu’un environnement favorable laisse à l’individu la possibilité d’épanouir ses potentialités innées. Un nourrisson normal peut se développer de façon anormale et devenir une personne déficiente si les conditions de son éducation sont défavorables (cause exogène) et inversement, un nourrisson porteur d’une anomalie génétique (cause endogène) peut compenser en partie son handicap si un environnement éducatif optimal est mis en place.

Sur le plan scientifique le débat change de nature. Il oppose deux options épistémologiques : Le préformisme et le constructivisme. Le préformisme ou le nativisme s’inscrit dans le courant de la psychologie évolutionniste et reprend l’hypothèse de la modularité de l’esprit de Fodor. Cette approche considère que l’enfant humain naît avec un cerveau forgé au cours de l’évolution et composé, tel un couteau suisse, de modules autonomes spécialisés dans des fonctions universelles mais précises. Comme Chomsky considérait que le cerveau était génétiquement équipé d’un organe cognitif spécifique au langage, on parle aujourd’hui des modules spécifiques à la reconnaissance des visages, l’imitation des mimiques faciales, la quantification, etc. Quand une région du cerveau portant un module entre en fonctionnement, dès la naissance où à un moment fixé par le calendrier génétique ou par des stimuli environnementaux, les dispositifs cognitifs de ce module peuvent s’exprimer et évoluer avec les apprentissages. Ce courant de recherche a largement réévalué les compétences précoces des nourrissons qui relèveraient de dispositions innées. La cognition adulte est incontestablement l’expression d’un cerveau structuré selon des zones spécialisées. Les lésions cérébrales localisées qui entraînent des déficits sélectifs le montrent. Mais cette observation n’implique pas que l’architecture modulaire du cerveau soit génétiquement fixée dès la naissance. Le constructivisme considère que seul le fonctionnement de l’intelligence est héréditaire et que les structures de la connaissance sont construites à partir de l’expérience du sujet dans son environnement. Piaget (1967) , par exemple ne pose pas de rupture fonctionnelle entre le biologique et la connaissance et conçoit l’intelligence comme un outil d’adaptation qui prolonge les adaptations biologiques de l’organisme à l’environnement. A la naissance, l’architecture modulaire du cerveau d’origine génétique serait tout au plus optionnelle. Compte tenu de sa plasticité, l’organisation du cerveau dépend de la longue ontogenèse qui caractérise l’être humain. Le petit humain naît humain selon l’expression de Mehler et Dupoux (2006) c’est-à-dire avec les potentialités de l’espèce humaine (il est équipé pour parler, marcher debout, etc.) mais s’il est écarté du groupe social, comme l’a été Victor de l’Aveyron, ces potentialités ne s’exprimeront pas (il ne marchera pas debout et ne parlera pas). Bref, c’est le développement lui-même qui constitue un processus progressif de modularisation.

Les Perspectives dépendent des réponses apportées aux questions suivantes : qu’est-ce que l’intelligence ? Est-elle mesurable ? La pratique des tests est-elle inadéquate par essence ? Est-il possible de construire de nouveaux tests scientifiquement fondés ?

La mesure de l’intelligence se heurte à des obstacles fondamentaux : on ne peut mesurer qu’un objet dont on connaît les propriétés. Or, on ne sait pas si l’intelligence est assimilable à un objet et si c’est le cas on est encore loin de connaître ses propriétés. Ce que nous appelons l’intelligence résulte du fonctionnement de processus mentaux extrêmement complexes et auxquels nous n’avons accès que de façon indirecte. La taille d’un enfant que l’on mesure existe objectivement avant d’être mesurée et un seul nombre la mesure. Le QI est un nombre dont on ne sait pas exactement à quelle réalité il renvoie et qui caractérise autant l’instrument de mesure que l’intelligence censée être mesurée. La boutade que l’on attribue à Binet « l’intelligence c’est ce que mesure mon test » signifie que l’intelligence n’est pas séparable de l’instrument qui la mesure. Les analyses de corrélation entre le test du bonhomme proposé par Goodenough (1926) et la version américaine du Binet-Simon (le Stanford-Binet) montrent qu’une tâche aussi élémentaire que le dessin du bonhomme peut constituer une épreuve acceptable de développement cognitif (cf. Baldy, 2002). Une des pistes proposées par Huteau et Lautrey (1999) pour définir des pratiques d’évaluation plus équitables consiste à évaluer le potentiel d’apprentissage des individus plutôt que leur performance actuelle dans un test. L’un des reproches adressés aux tests d’intelligence est d’évaluer l’efficience intellectuelle de l’individu de façon ponctuelle et statique. Pourquoi ne pas évaluer la capacité du sujet à progresser quand on lui en donne l’occasion? Cette vieille idée a été relancée par la diffusion en France du Programme d’Enrichissement Instrumental de Feuerstein et des travaux de Vygotsky. Pratiquement, il s’agit d’administrer le test une première fois de proposer ensuite au sujet un apprentissage plus ou moins standardisé et d’administrer à nouveau le test. Le potentiel d’apprentissage est évalué par le gain entre les deux tests ou par le nombre d’aides nécessaires dans la phase d’apprentissage. Cette évaluation dynamique est intéressante dans une perspective d’éducabilité cognitive.

Les enfants possédant des niveaux intellectuels différents sont aussi des élèves à l’école ce qui pose de fait la question de l’hétérogénéité des classes. Rappelons d’abord que l’orientation et la sélection des élèves reposent sur les notes et les appréciations des professeurs et que c’est heureux car les résultats scolaires, dont on peut toujours améliorer la validité, constituent un signe extérieur d’intelligence au moins aussi pertinent que le QI. Il y a d’ailleurs une forte corrélation positive entre les deux. Certes, les différences de capacités d’apprentissage des élèves entraînent une hétérogénéité des classes qui doit rester compatible avec la mise en oeuvre une pédagogie différenciée. Cependant, aux logiques ségrégatives économiques, sociales et urbaines dont l’école n’est pas responsable, les enseignants ne doivent pas ajouter une logique psychologique adossée d’un côté au handicap socio-culturel des enfants d’ouvriers et de l’autre au don ou au sur-don des enfants de cadres. Cette dernière catégorie d’enfants fait aujourd’hui débat dans la société. Dits à haut potentiel intellectuel, ils ont un QI considéré comme exceptionnellement élevé (>130) et représentent donc par construction 2,2% de la population soit environ 200 000 élèves entre 6 et 16 ans. Selon le rapport Delaubier (2002), 5% d’entre eux, soit 10 000 élèves, le plus souvent des garçons issus de familles favorisées et très investies dans la réussite scolaire, rencontrent des difficultés scolaires : troubles comportementaux, difficultés d’apprentissage, sur-investissement de certains domaines et abandon d’autres, mal-être, ennui, manque d’intérêt, rejet de l’école, difficulté d’intégration, isolement, etc. Cette apparente contradiction entre l’efficience intellectuelle révélée par le WISC et les difficultés scolaires s’explique par le déséquilibre entre des potentialités exceptionnelles (compréhension verbale, par exemple) et des carences graves (coordinations motrices, par exemple) qui engendrent l’échec et par le décalage entre les besoins de ces enfants, tant sur le plan cognitif que socio-affectif, et le fonctionnement du système éducatif.

Une classe est généralement composée d’élèves qui réussissent correctement dans l’ensemble des disciplines sans posséder un talent exceptionnel et sans rencontrer de difficultés insurmontables et d’élèves dont les difficultés engendrent des besoins spécifiques. Il est vrai que le système éducatif ne parvient pas toujours à répondre à ces besoins. Cependant, après avoir supprimer les classes de faible niveau, il faut réfléchir à deux fois avant de créer des classes d’élite. Il semble préférable que cette prise en charge se fasse autant que possible sans discrimination. Plusieurs solutions sont envisageables : adapter les programmes, les rythmes, les parcours, les méthodes, emménager le temps scolaire, enrichir les contenus, développer des programmes personnalisés d’aide et de progrès, élargir les centres d’intérêts, utiliser les TIC, etc. Il ne faut pas oublier que l’école est un lieu de vie dans lequel les enfants acquièrent des connaissances académiques et développent des compétences sociales et émotionnelles qui contribuent à la formation de leur personnalité. Les forts en ceci et les faibles en cela doivent apprendre à vivre ensemble sur la base de relations équilibrées.

René Baldy, Université Paul Valéry de Montpellier.

Bibliographie

– Baldy, R. (2002). Dessine-moi un bonhomme. Dessins d’enfants et développement cognitif. Paris : In Press éditions.

Commander cet ouvrage avec Alapage

– Binet, A. (1911). Les idées modernes sur les enfants. Paris : Flammarion.

Commander cet ouvrage avec Alapage

– Binet, A. & Simon, Th. (1966). La mesure du développement de l’intelligence chez les jeunes enfants. Paris : Armand Colin. (15° édition).

Commander cet ouvrage avec Alapage

– Damasio, A. (1995). L’erreur de Descartes. La raison des émotions. Paris : Odile Jacob.

Commander cet ouvrage avec Alapage

– Gardner, H. (1997). Les formes de l’intelligence. Paris : Odile Jacob

Commander cet ouvrage avec Alapage

– Goleman, D. (1997). L’intelligence émotionnelle. Comment transformer ses émotions en intelligence ? Paris : Robert Laffont.

Commander cet ouvrage avec Alapage

– Goodenough, F. (1926). L’intelligence d’après le dessin, le test du bonhomme. Paris : PUF.

– Grégoire, J. (2006). L’examen clinique de l’intelligence de l’enfant. Fondements et pratique du Wisc-IV. Sprimont : Mardaga.

Commander cet ouvrage avec Alapage

– Huteau, M. & Lautrey, J. (1999). Evaluer l’intelligence. Psychométrie cognitive. Paris : PUF.

Commander cet ouvrage avec Alapage

– Mehler, J. & Dupoux, E. (2006). Naître humain. Paris : Odile Jacob.

Commander cet ouvrage avec Alapage

– Piaget, J. (1967). Biologie et connaissance. Essai sur les relations entre les régulations organiques et les processus cognitifs. Paris : Gallimard.

Commander cet ouvrage avec Alapage

– Tort, M. (1974). Le quotient intellectuel. Paris : Maspero.

– Weschler, D. (1944). Measurement of adult intelligence. Baltimore : Williams and Wikins

– Zazzo, R., Gilly, M. & Verba-Rad, M. (1966). Nouvelle échelle métrique de l’intelligence. Paris : Colin